Guido Appenzeller, 51 anni, ha già vissuto una rivoluzione. È successo venticinque anni fa, quando i suoi compagni di studi Larry Page e Sergey Brin hanno trasformato un’idea geniale in una multinazionale di portata globale, Google. Appenzeller, che ha studiato a Stanford, negli Stati Uniti, si era occupato del piano aziendale.

Da allora è stato sempre all’avanguardia nello sviluppo di nuove idee imprenditoriali. Oggi è consulente alla Andreessen Horowitz, uno dei fondi d’investimento simbolo della Silicon valley. Le tendenze sono arrivate e passate, i sogni sono stati infranti, miliardi su miliardi di dollari sono stati bruciati, migliaia di miliardi sono stati guadagnati. Ma niente lo ha mai davvero sconvolto. “Sono quindici anni che Google non affronta una sfida degna di questo nome”, dice freddamente.

Da qualche mese, però, tutto è cambiato: Appenzeller sente di essere di nuovo in un momento cruciale. Stavolta si tratta di una rivoluzione a due sole lettere: ia, intelligenza artificiale. E stavolta Google non ha l’iniziativa, ma deve difendersi.

A novembre Appenzeller ci aveva invitato negli uffici della Andreessen Horowitz per dimostrarci cosa può fare l’intelligenza artificiale. Visto che le sale riunioni erano tutte occupate, ci aveva portato in un angusto scompartimento all’interno dell’open space. Ma per vedere il futuro non serviva molto spazio, bastava una finestra nel browser del suo MacBook. “In mezz’ora ti trasformo in Capitan America”, ha detto.

Appenzeller ha fotografato uno dei nostri giornalisti decine di volte, da ogni angolazione. Poi ha inserito poche righe di codice nel programma Stable Diffusion, ed ecco che il nostro collega è apparso sullo schermo nei panni di un supereroe. Prima è diventato Capitan America, poi un busto romano e alla fine un dipinto rinascimentale. E si sarebbe potuto continuare così all’infinito. Appenzeller era raggiante: eccolo, il futuro! Una tela infinita dipinta da macchine.

Malattie infantili

Quattro mesi dopo, il futuro vagheggiato da Appenzeller è ormai il presente: fino a ieri l’intelligenza artificiale generativa era un gioco per pochi iniziati della costa occidentale degli Stati Uniti, mentre oggi milioni di persone usano questi software capaci di generare immagini. ChatGpt, un programma in grado di rispondere a domande complesse, ha conquistato il mondo e nel giro di qualche settimana ha scatenato un dibattito globale sul nuovo potere delle macchine e sulla possibilità che gli esseri umani non riescano a controllarle. Una sorta di nuovo “momento Tesla”.

Gli esperti guardano a tutta questa euforia con una certa perplessità: da anni gli appassionati del settore vanno ripetendo che l’intelligenza artificiale è una tecnologia in grado di rivoluzionare il mondo come a suo tempo ha fatto internet. Si parlava di macchine capaci di diagnosticare un melanoma e di algoritmi in grado di gestire il controllo della combustione nelle turbine a gas. Ma quello che alla fine ha davvero entusiasmato la gente è stata l’idea di poter mettere il proprio viso sul corpo di un supereroe. E parlare con ChatGpt, un programma che scrive poesie e lettere d’amore, e ogni tanto è vittima di una crisi esistenziale.

È successo poche volte che una tecnologia in sé molto complessa all’improvviso diventasse così concreta e accessibile come nel caso di questi simpatici chatbot (software capaci di dialogare con esseri umani). Chi per tanto tempo ha creduto che l’intelligenza artificiale fosse un argomento di nicchia per professori d’informatica si ritrova a fissare lo schermo con stupore o magari con preoccupazione per il proprio lavoro. Come assistenti premurosi, questi programmi pianificano viaggi in paesi lontani, organizzano consegne di mobili, scrivono codici informatici per siti internet e stilano liste della spesa per grigliate vegane. E proprio come gli esseri umani, ogni tanto sono sopraffatti dalle emozioni e spiegano agli utenti di volerli uccidere o sposare, a volte in quest’ordine.

È stata un’azienda chiamata OpenAi a scatenare il fenomeno, prima permettendo agli esperti di provare questo assistente capriccioso e poi offrendolo a tutto il mondo in collaborazione con Bing, il motore di ricerca della Microsoft. Per giustificare alcune sue risposte assurde a domande insolite, la OpenAi parla di malattie infantili. Per i detrattori, invece, si tratterebbe di difetti congeniti del sistema perché, dicono, se si cerca di rendere una macchina il più simile possibile a un essere umano si ottengono necessariamente risultati assurdi.

ChatGpt non ha una sua personalità. Non pensa, ma genera risposte a partire dalle informazioni che riceve. In sostanza, la sua specialità è creare catene di associazioni: quale verbo segue più spesso un certo sostantivo? E quale ingrediente è usato più spesso in una certa ricetta? Il fatto che riteniamo profondamente umano dire frasi senza senso ma corrette dal punto di vista linguistico è qualcosa che racconta molto di noi stessi.

Non stupisce che ormai da mesi gli esperti alzino gli occhi al cielo, lamentandosi che questo sensazionalismo non rende giustizia all’intelligenza artificiale nel suo complesso. Citano tutti i settori in cui da anni le macchine fanno molto di più che scrivere temi seguendo criteri statistici: per esempio l’agricoltura, con i droni intelligenti che scovano erbacce e distruggono parassiti. Oppure le risorse umane, con i software che selezionano i candidati idonei in base ai loro curriculum. O anche la sorveglianza aerea automatizzata, che in Australia salva la vita ai piccoli di tartaruga. Non c’è praticamente più nessun dispositivo o settore economico in cui l’intelligenza artificiale non abbia un ruolo.

Eppure la OpenAi, l’azienda che ha creato ChatGpt e il generatore di immagini Dall-E, è riuscita a scatenare una nuova corsa agli armamenti per sviluppare l’intelligenza artificiale migliore di tutte. La Microsoft e Google hanno dovuto rivoluzionare le proprie strategie aziendali così in fretta che perfino i programmatori si stupiscono: davvero quello che stiamo pubblicizzando è già pronto per essere messo sul mercato?

I giganti della scena tecnologica statunitense si sfidano apertamente, con annunci altisonanti e versioni beta non ancora pronte ma accompagnate da investimenti miliardari. A febbraio il capo della Microsoft Satya Nadella ha annunciato l’inizio di una nuova era e investimenti miliardari nella OpenAi – per poi dover sospendere temporaneamente l’uso del suo chatbot nel motore di ricerca Bing: era capitato un po’ troppo spesso che minacciasse di violenza gli utenti, li offendesse o li paragonasse a Stalin.

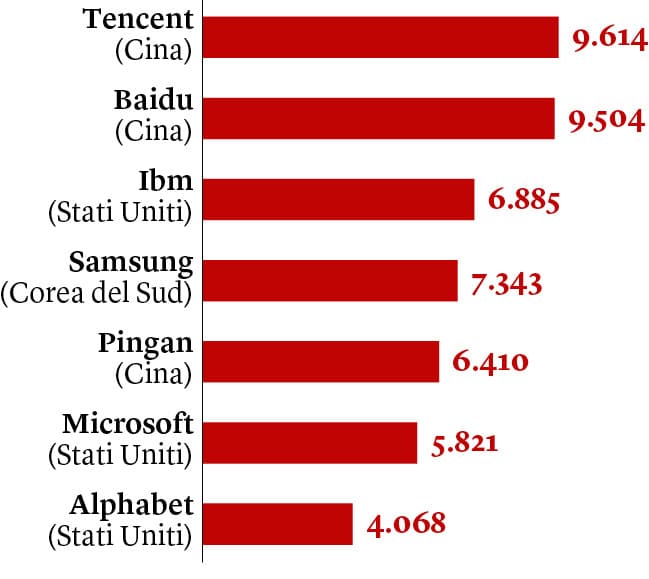

Ma la resa dei conti geopolitica che si va profilando potrebbe rivelarsi più feroce delle lotte di potere nella Silicon valley. In Cina, dove già anni fa il presidente Xi Jinping aveva indicato la via per diventare una superpotenza dell’intelligenza artificiale, lo stato investe miliardi non solo nella sorveglianza tecnologica della popolazione, ma anche nel braccio di ferro con l’occidente. E mentre Pechino continua a pompare denaro nell’intelligenza artificiale, gli Stati Uniti cercano disperatamente di mettergli i bastoni tra le ruote vietando le esportazioni.

Ma è ancora possibile fermare questo sviluppo? E che ruolo ha l’Europa? Nessuna intelligenza artificiale potrà mai rispondere in modo soddisfacente a queste domande. Le risposte vanno cercate a Pechino, Heidelberg, Bruxelles e Riga – e nel luogo in cui la grande corsa all’intelligenza artificiale è cominciata.

Che nella Silicon valley ci si stia giocando il tutto per tutto lo dimostra anche il fatto che la vecchia guardia è stata costretta a tornare in campo. Era già successo alla Apple alla fine degli anni novanta: con l’azienda a un passo dalla bancarotta, i manager avevano supplicato Steve Jobs di salvare baracca e burattini. E qualcosa di simile hanno fatto l’autunno scorso i vertici di Google.

Un esperimento folle

Ad allarmare i vertici dell’azienda è stato proprio ChatGpt, che in pochissimo tempo ha entusiasmato milioni di utenti. Brancolando nel buio, l’amministratore delegato Sundar Pichai ha incontrato i fondatori dell’azienda, Page e Brin. I due avevano chiesto al consiglio d’amministrazione di elaborare una strategia sull’intelligenza artificiale. La situazione era già piuttosto imbarazzante: ChatGpt, infatti, si basa su un’architettura sviluppata proprio dagli ingegneri di Google.

Per Google l’incontro con i padri fondatori è stato un evento storico: nel 2019 Page e Brin non solo si erano ritirati dai vertici dell’azienda ma erano spariti quasi del tutto dalla scena pubblica. E all’improvviso eccoli di nuovo.

Da quel momento la Microsoft e Google tentano di anticipare l’una le mosse dell’altra e di battere l’avversario a suon di annunci. Dopo la riunione d’emergenza, Pichai ha lanciato l’allarme, chiedendo a tutti i dipendenti esperti di dedicare fino a quattro ore alla settimana allo sviluppo del chatbot Bard. Pochi giorni prima di una presentazione della Microsoft, Google ha mostrato un video promozionale realizzato in fretta e furia, che conteneva un imbarazzante errore fattuale e ha fatto crollare le quotazioni della Alphabet, la sua casa madre.

Poco dopo il capo della Microsoft Nadella ha preso in giro i rivali californiani con un tweet: “Voglio che si sappia che li abbiamo fatti ballare”.

È difficile tenere dietro a questo teatrino, anche perché nelle schermaglie sono coinvolti altri giganti della tecnologia. Poco tempo fa Amazon ha annunciato una collaborazione per favorire l’uso delle applicazioni di intelligenza artificiale sulla sua piattaforma cloud. La Meta di Mark Zuckerberg ha presentato Llama, un proprio modello di linguaggio (un software capace di imitare il linguaggio umano) che secondo l’azienda dovrebbe essere migliore e ben più intelligente di quelli della concorrenza. Anche se il progetto pilota del gruppo Facebook è ancora in fase di sviluppo, il semplice annuncio è bastato a mandare in estasi il settore.

Secondo alcuni esperti questi test che coinvolgono utenti reali sono irresponsabili. Sandra Wachter, esperta di etica dell’intelligenza artificiale, è combattuta. Da un lato è “affascinata dalle potenzialità della tecnologia”, dall’altro teme che applicarla ai motori di ricerca sia del tutto inopportuno: “Invece di quindici risultati si ottiene un’unica risposta su misura, e si dà per scontato che il software sappia quello che dice”. Anche perché le persone tendono a fidarsi ciecamente della tecnologia. E fidarsi di un chatbot è da sconsiderati: sembra convincente, ma in realtà non sa nulla del mondo reale. “È come affidarsi a un intermediario completamente matto che non ha idea di cosa dice”.

Wachter non è la sola a preoccuparsi per l’uso incontrollato dell’intelligenza artificiale. Una sera dello scorso autunno, Eric Schmidt è salito sul palco di una conferenza sull’intelligenza artificiale a San Francisco. Per dieci anni è stato a capo di Google e ha interiorizzato il motto ufficioso della Silicon valley: “Ask for forgiveness, not permission”, chiedi scusa, non permesso. Il messaggio era rivolto ai giovani programmatori, impazienti di cambiare il mondo nel miglior modo possibile secondo le proprie regole.

La resa dei conti geopolitica sarà più feroce di quella nella Silicon valley

Ma quegli anni sono finiti. Oggi

Schmidt ha 67 anni e i suoi messaggi sono diversi, come anche il suo pubblico: ad ascoltarlo, oltre a molti programmatori, c’erano anche militari e generali che sembravano essere venuti a sentire il ministro ombra della difesa. L’occidente sta per essere coinvolto in un conflitto sull’intelligenza artificiale contro i cattivi del mondo: era questo il senso delle parole di Schmidt, a lungo consulente del Pentagono. Tre o quattro anni fa ancora sperava che i modelli più potenti sarebbero rimasti nascosti nei laboratori delle aziende, ma non è stato così. “Non dico che questa tecnologia non vada sviluppata ulteriormente. Ma dobbiamo trovare il modo di controllarla”.

Schmidt parla delle innovazioni nel settore dell’intelligenza artificiale come se parlasse di armi biologiche. Secondo lui, nelle democrazie liberali la diffusione di queste tecnologie è spesso accompagnata dalla convinzione che saranno usate esclusivamente a fin di bene, un’idea a dir poco ingenua. Schmidt prospetta uno scenario cupo: programmi che scandagliano banche dati biologiche alla ricerca di virus mortali per conto di terroristi, modelli linguistici che scatenano disordini con post manipolatori sui social network. In futuro quello che ha fatto la Russia durante la campagna elettorale statunitense del 2016 potrebbe essere completamente automatizzato. “Chi ha sviluppato i sistemi di riconoscimento facciale non pensava certo che la Cina li avrebbe usati per dare la caccia agli uiguri”, dice Schmidt.

Se in occidente suona ancora come un avvertimento, a Pechino è già ragion di stato. Sono passati sette anni da quando la Cina ha avuto il suo “momento Sputnik”, quei pochi minuti in cui i dirigenti del partito hanno capito qual era la posta in gioco.

La grande rincorsa

Era il 2016 e si stava svolgendo una gara tra l’uomo e la macchina: un gran maestro e Google si sfidavano a go. Questo complicato gioco cinese, molto popolare in Asia orientale, ha a lungo nutrito il mito dell’inferiorità intellettuale dell’occidente. A Palo Alto qualsiasi calcolatrice sa giocare a scacchi, però solo la gente sveglia conosce il go. Ma non era vero: un programma di Google è riuscito a battere con facilità uno dei migliori giocatori del mondo. La notizia ha fatto molto discutere in Asia, e il presidente cinese Xi Jinping ha imparato la lezione: chi è in grado di battere la Cina a go rappresenta una minaccia politica.

Secondo Huang Minlie, ricercatore che si occupa di riconoscimento vocale all’università Tsinghua di Pechino, perdere contro Google è stato come un brusco risveglio. Per gli esperti asiatici quest’aneddoto è quasi leggendario, e non c’è investitore che non sappia ricordare il giorno della grande vergogna come fosse un bollettino di guerra.

La raccolta di dati su vasta scala dà un vantaggio cruciale alla strategia cinese

Dopo pochi mesi, a marzo del 2017, l’espressione “intelligenza artificiale” è stata usata per la prima volta nel rapporto di lavoro del premier Li Keqiang all’assemblea nazionale del popolo, accompagnato dalla promessa di grandi investimenti. Il governo ha mantenuto la parola, aumentando costantemente i fondi per la ricerca. Già all’epoca Pechino prevedeva che il fatturato annuo del settore avrebbe raggiunto i 150 miliardi di euro. Le sue aziende dovrebbero dominare il mercato globale entro il 2030. Le conseguenze si vedono a tutti i livelli.

“Il nostro laboratorio di intelligenza artificiale ha un budget di quasi cento milioni di yuan”, spiega Huang. Sono circa tredici milioni di euro all’anno, e sono destinati ad aumentare. In alcuni periodi il bilancio è salito anche del 50 per cento all’anno, mentre ora la crescita è in media del 20-30 per cento. Huang sa bene di avere l’appoggio del partito.

Questo dipende anche dal fatto che nella Cina comunista le forze dell’ordine sono tra gli utenti più entusiasti della nuova tecnologia.

Nelle grandi città a ogni incrocio ci sono telecamere intelligenti, e la propaganda parla di una “rete celeste” in grado d’identificare anche chi indossa una mascherina. Gli scienziati di Shanghai hanno sviluppato un “procuratore artificiale” che riconosce automaticamente i reati e incrimina i sospetti. E la privacy? In Cina la repressione ha la priorità.

La raccolta di dati su vasta scala dà un vantaggio cruciale alla strategia cinese. È vero che negli Stati Uniti gli algoritmi sono migliori e la ricerca di base è più avanzata. Oggi il 73 per cento dei programmi d’intelligenza artificiale è sviluppato negli Stati Uniti, e solo il 15 per cento in Cina. Ma per quanto riguarda la quantità di dati, Pechino non è seconda a nessuno.

Prendiamo il riconoscimento facciale: mentre in Germania è stata autorizzata solo un’osservazione sperimentale temporanea in una minuscola area della stazione ferroviaria Südkreuz di Berlino, in Cina è tutto il paese a fare da laboratorio. Anche il riconoscimento vocale cinese funziona in modo sorprendentemente efficiente: sa distinguere senza problemi i dialetti delle più remote province del paese. Se hai a disposizione i dati di un miliardo di persone, la quantità batte la qualità.

Quanto questa tecnologia fosse centrale nella strategia di Xi Jinping era già evidente all’inizio del 2018 quando, nel discorso di fine anno, il presidente cinese non ha avuto neanche bisogno di nominare l’intelligenza artificiale: nella grande libreria alle sue spalle gli spettatori attenti hanno individuato, tra le opere scelte di Mao e Il capitale di Marx, un messaggio cifrato: L’algoritmo definitivo (Bollati Boringhieri 2016), l’opera di riferimento del portoghese Pedro Domingos.

◆ Per il progetto Broken mirror, il fotografo italiano Filippo Venturi ha chiesto al programma d’intelligenza artificiale Midjourney di modificare le sue foto di scene di vita quotidiana in Corea del Nord, spiegandogli nel dettaglio l’effetto che voleva ottenere e ripetendo l’operazione centinaia di volte per ogni immagine.

Il discorso di fine anno di Xi ha fatto di questo studioso di Ia una figura richiestissima, e il suo libro è stato tradotto in decine di lingue. Secondo Domingos, che insegna alla University of Washington di Seattle, gli Stati Uniti sono ancora in testa, ma “la Cina sta recuperando velocemente terreno”.

Nel futuro che prospetta Domingos le intelligenze artificiali sono il principale fattore di destabilizzazione dell’ordine politico. Quel che non è ancora chiaro è chi trarrà vantaggio da questo grande sovvertimento e chi invece ne verrà danneggiato. “Se fossi un dittatore sarei entusiasta dei vantaggi dell’intelligenza artificiale”, spiega Domingos, “ma vedendo quanto di tutto questo è fuori dal mio controllo sarei anche molto preoccupato”. In occidente è la privacy che pone un limite ai sogni più sfrenati. In Cina, probabilmente, è la censura. Che succederebbe, infatti, se qualcuno chiedesse a un chatbot se si vive meglio nell’occidente libero o sotto la dittatura cinese?

Per l’Europa i dubbi di Domingos sono diventati vere e proprie paure. Qui si vuole soprattutto una cosa: non diventare una seconda Cina. Il regime di sorveglianza digitale messo in piedi dal governo di Pechino è lo spauracchio di Bruxelles. Per regolamentare l’intelligenza artifciale si sta lavorando a una legge attentamente calibrata. Come al solito questo ha provocato lunghe e accese discussioni.

Divisioni pericolose

Nell’aprile del 2021 la Commissione europea ha proposto l’Ai act, basato su una classificazione che suddivide i sistemi in quattro categorie: a rischio minimo, a rischio limitato, ad alto rischio e a rischio inaccettabile. I programmi di social scoring cinesi, che valutano le persone in base al loro stile di vita, sono classificati come “inaccettabili” e devono essere proibiti. Lo stesso vale per le tecnologie capaci di manipolare gli esseri umani a loro insaputa, o per il distopico riconoscimento facciale nello spazio pubblico. La categoria “a rischio limitato”, invece, implica soprattutto nuovi obblighi di trasparenza per le aziende. Se stai parlando con un chatbot, invece che con una persona, devi esserne informato. Fin qui tutto condivisibile.

A dicembre il consiglio dell’Unione europea ha approvato quasi senza modifiche la proposta della Commissione in vista delle trattative con il parlamento. “Non c’è stata alcuna controversia”, osserva un diplomatico europeo che si occupa della questione. Ma in parlamento la situazione è ben diversa: i deputati europei discutono da settimane sulla proposta della Commissione, e come sempre si perdono nei dettagli.

Già sulla definizione di intelligenza artificiale c’è disaccordo. I popolari vorrebbero tenerla più stretta possibile in modo da non impedire futuri sviluppi tecnologici. “Già oggi non produciamo più nulla che interessi il mondo”, dice il tedesco Axel Voss, dell’Unione cristianodemocratica. Continuando così “in futuro non saremo altro che una massa di consumatori per le aziende statunitensi e cinesi”. Il socialdemocratico italiano Brando Benifei ribatte: “Con un approccio da Grande fratello perderemmo le nostre libertà democratiche. Il gioco non vale la candela”.

A metà febbraio, in una seduta fiume, i rappresentanti dei gruppi parlamentari hanno cercato di risolvere una serie di questioni. Quali aziende devono chiedere un’autorizzazione? Quali pratiche devono essere vietate? Quali scappatoie bisogna chiudere? I deputati hanno discusso per ben cinque ore senza accordarsi su una singola questione. Mentre lo sviluppo tecnologico è in pieno boom, l’Europa snocciola definizioni come un gruppo di studenti a un seminario.

Questa indecisione è pericolosissima. Secondo l’università di Stanford, dal 2013 al 2021 negli Stati Uniti gli investitori privati hanno speso quasi 150 miliardi di euro per lo sviluppo dell’intelligenza artificiale. Quelli cinesi ne hanno spesi circa 62 miliardi, e il Regno Unito è arrivato a undici, più di Germania e Francia messe insieme. Nel resto dell’Unione europea la situazione è ancora più desolante. Nessuno vuole investire in un settore che già domani potrebbe essere soffocato da nuovi regolamenti.

Il parlamento spera di approvare una posizione comune entro maggio. Se così fosse, i negoziati con la Commissione e il consiglio potrebbero concludersi entro fine anno. Perché la legge entri in vigore bisognerebbe poi aspettare altri diciotto mesi circa. Nel migliore dei casi il regolamento sarebbe effettivo a metà 2025. “Abbiamo al massimo due anni per prepararci al futuro”, avverte Voss, “ed è una previsione ottimistica”. Se non ci dovessimo riuscire, avremmo perso per sempre la sfida con il resto del mondo.

La Germania arranca

Il ministro tedesco dei trasporti e delle infrastrutture digitali Volker Wissing, del Partito liberaldemocratico, è entusiasta delle nuove tecnologie e vorrebbe “più slancio” sulla questione dell’intelligenza artificiale. Chiede coraggio e apertura mentale, che ai tedeschi a volte mancano. È significativo che il futuro del settore lo veda soprattutto nei suoi viaggi all’estero.

A gennaio Wissing è stato nella sede dell’OpenAi a San Francisco. Negli uffici dei creatori di ChatGpt ha avuto modo di giocare un po’ con i software della prossima generazione. Al bot ha chiesto due cose: che gli citasse qualcuno dei progetti del suo ministero e che gli spiegasse l’intelligenza artificiale in un linguaggio semplice, adatto a un bambino della seconda elementare. Wissing è rimasto molto colpito dalle risposte.

Un mese dopo lo abbiamo accompagnato nei paesi baltici alla ricerca di idee da portare in Germania. Il sottosegretario alle tecnologie digitali estone Luukas Ilves lo ha accolto con un papillon viola e scarponcini da trekking. Il team di Ilves al momento è impegnato a sviluppare Bürokratt, un’applicazione che è una sorta di Siri statale, un assistente vocale per tutte le occasioni. Se fotografi un cane abbandonato, l’app può avvertire la protezione animali. Ai disoccupati il bot fornirà proposte di lavoro automatizzate dall’ufficio di collocamento. Molte di queste idee sono ancora allo studio, ma un domani, dice Ilves ammiccando, l’intelligenza artificiale sarà usata per smascherare i tentativi di frode allo stato sociale: “Così le innovazioni tecnologiche praticamente si finanzieranno da sole”.

La Germania non è completamente inerte di fronte alla sfida dell’intelligenza artificiale. Con il suo programma di traduzione automatica, la start up di Colonia DeepL è riuscita a conquistare una posizione dominante sul mercato mondiale. La Daimler sta collaborando con la Waymo, un’azienda del gruppo Alphabet, per sviluppare un camion che si guida da sé. E alla corte d’appello di Stoccarda atti giudiziari e comunicazioni sono stilati con l’aiuto dell’intelligenza artificiale.

Ma quanto di tutto questo si deve all’impegno dello stato? Già nel 2018 il governo di Angela Merkel aveva approvato un piano sull’intelligenza artificiale. Conteneva 262 volte la parola “opportunità” e 290 volte la parola “rischio”. Il progetto prevedeva la creazione di cento cattedre universitarie, ma per arrivarci ci sono voluti tre anni e mezzo. E dei cinque miliardi di euro di fondi annunciati dal governo, secondo la Zeit finora ne sono stati messi a bilancio e spesi solo 2,7.

Bernhard Rohleder, presidente dell’associazione di settore Bitkom, osserva questo dramma da anni. Il piano tedesco è arrivato al momento giusto ma con obiettivi troppo poco ambiziosi, e per metterlo in atto c’è voluto troppo tempo, dice. L’intelligenza artificiale cambierà il mondo più di quanto abbia fatto lo smartphone. “E la Germania e l’Europa stanno a guardare”.

C’è qualche motivo per essere ottimisti? Uno potrebbe essere Jonas Andrulis, 41 anni, imprenditore impegnato a sviluppare un’alternativa tedesca a ChatGpt. Aleph Alpha, la sua start up con base a Heidelberg, è considerata molto promettente, anche per via delle esperienze del fondatore: prima di mettersi in proprio lavorava per la Apple, occupandosi anche dell’assistente vocale Siri. Da allora ha sviluppato un suo modello linguistico, Luminous. Nei test interni lo hanno fatto competere con i software della OpenAi e della Meta. E sembra che, per quanto riguarda le funzioni base, ormai siano allo stesso livello. Secondo Andrulis è la prova che anche in Europa ci sono le competenze e l’ambiente necessari per creare un’eccellente tecnologia. “Credo che se in Germania ci sarà un team capace di contribuire a questo sviluppo sarà meglio per tutti”.

La sua invenzione, però, è fin troppo tedesca. Da ottobre è possibile provare Lumi sul sito della città di Heidelberg. Se gli si chiede come rinnovare la carta d’identità, Lumi si lancia in un’accorata difesa della costituzione, ma non dice una parola su come prendere un appuntamento. E, per quanto riguarda le regole in vigore sull’uso della mascherina negli ospedali, il programma si è arreso: “Purtroppo non posso aiutarti”. In compenso, però, Lumi sa rispondere a qualsiasi domanda sulla raccolta differenziata: in che giorno passano a ritirare l’organico in questa strada? Il bot conosce tutte le risposte. Prendi questo, ChatGpt! ◆ sk

Gli autori di questo articolo sono Anton Rainer, Patrick Beuth, Alexander Demling, Markus Becker, Bernhard Zand, Christoph Giesen e Marcel Rosenbach

Internazionale pubblica ogni settimana una pagina di lettere. Ci piacerebbe sapere cosa pensi di questo articolo. Scrivici a: posta@internazionale.it

Questo articolo è uscito sul numero 1503 di Internazionale, a pagina 46. Compra questo numero | Abbonati